Jake Moore, Global Cybersecurity Advisor w ESET, przeprowadził w kwietniu 2026 roku serię eksperymentów, które wstrząsnęły branżą bezpieczeństwa cyfrowego. Używając wyłącznie ogólnodostępnego sprzętu i darmowego oprogramowania, zhakował trzy systemy rozpoznawania twarzy – w miejscu publicznym, banku i na stacji kolejowej. Wyniki badania, które szybko podchwyciły The Guardian, BBC i Forbes, stawiają pod znakiem zapytania fundamentalne założenia o bezpieczeństwie danych biometrycznych.

Kiedy twarz przestaje być dowodem tożsamości

Rozpoznawanie twarzy uchodzi dziś za jedną z najpewniejszych metod weryfikacji tożsamości. Banki stosują je przy zakładaniu kont online, lotniska przy odprawie pasażerów, a systemy monitoringu miejskiego – do identyfikacji osób poszukiwanych. Moore postanowił sprawdzić, na ile to zaufanie jest uzasadnione. Jego wniosek po trzech eksperymentach okazał się druzgocący: systemy biometryczne są kruche w sposób, który ma realne znaczenie, gdy ktoś zdecyduje się je złamać.

Wyniki badania zostały opublikowane przez ESET na blogu WeLiveSecurity w marcu 2026 roku i zaprezentowane w formie live demo podczas konferencji RSAC 2026 w San Francisco. Sesja nosiła wymowny tytuł: „Facing Reality: Hacking Facial Recognition”. Po tym wystąpieniu branżowe media niemal zgodnie uznały prezentację Moore’a za jedno z najważniejszych wydarzeń konferencji.

Trzy eksperymenty, trzy przełamane zabezpieczenia

Każdy z trzech testów dotyczył innego scenariusza użycia technologii facial recognition. Razem tworzą obraz ekosystemu bezpieczeństwa z fundamentalnymi lukami – i co istotne, lukami dostępnymi dla każdego, kto dysponuje laptopem i cierpliwością.

Pierwszy eksperyment dotyczył inteligentnych okularów. Moore kupił parę okularów Meta Ray-Ban z wbudowaną kamerą, które następnie sparował z komercyjnym systemem rozpoznawania twarzy Corsight. Spacerując w przestrzeni publicznej, w czasie rzeczywistym przechwytywał twarze mijanych osób i porównywał je z publicznie dostępnymi bazami danych. W ciągu kilku sekund system zwracał imiona, nazwiska i profile w mediach społecznościowych. W ciągu 30 minut udało mu się zidentyfikować ponad 10 osób. Wcześniej przeprowadził też prostszy test – wgrał zdjęcie twarzy swojej znajomej prawniczki Amy do PimEyes, publicznie dostępnej wyszukiwarki twarzy, i w kilkanaście sekund uzyskał listę miejsc w sieci, w których pojawia się jej wizerunek.

„Widzieć to już nie znaczy wierzyć. Systemy weryfikacji tożsamości muszą ewoluować szybko – i to nie jest kwestia odległej przyszłości.” – Jake Moore, Global Cybersecurity Advisor, ESET.

Drugi scenariusz wymierzony był w sektor finansowy. Moore stworzył fikcyjną tożsamość: sfałszował dokument tożsamości za pomocą powszechnie dostępnego programu graficznego, a następnie wygenerował syntetyczną twarz przy użyciu narzędzia AI. Tak przygotowany zestaw trafił do systemu eKYC (elektroniczna weryfikacja tożsamości klienta) pewnego banku – systemu podobnego do tych stosowanych przez instytucje takie jak HSBC czy Revolut. Platforma biometryczna zaakceptowała fikcyjną osobę jako prawdziwego klienta. Konto zostało założone w mniej niż 5 minut. Moore natychmiast je zamknął i ujawnił lukę instytucji, która od tamtej pory zablokowała tę konkretną ścieżkę ataku.

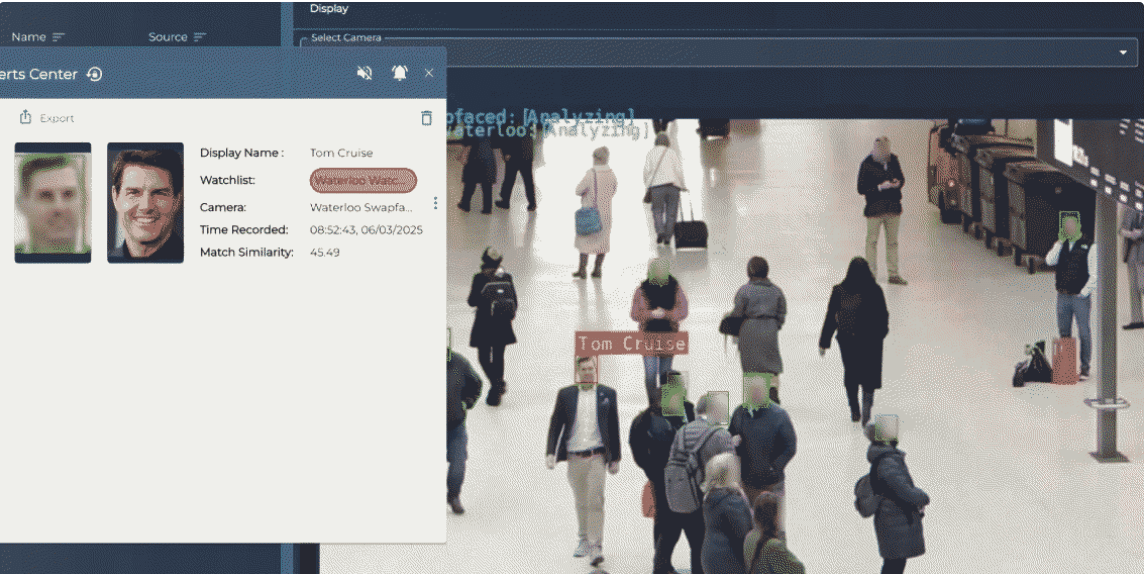

Trzeci eksperyment rozegrał się na londyńskiej stacji kolejowej Waterloo. We współpracy ze służbami bezpieczeństwa obiektu Moore dodał siebie do listy obserwowanych przez system monitoringu oparty na Corsight – tego samego oprogramowania używanego przez brytyjską policję. Następnie przeszedł przez monitorowaną strefę, uruchamiając oprogramowanie do zamiany twarzy w czasie rzeczywistym, które w wizji kamery zastąpiło jego oblicze wizerunkiem Toma Cruise’a. Dla ludzkich operatorów nagranie z CCTV wyglądało zupełnie normalnie. Dla algorytmu – Moore nie był Moore’em. System go nie wykrył. Alarm nie zadziałał.

Najtańsze narzędzia, największe zagrożenia

To, co sprawia, że wyniki eksperymentu są szczególnie niepokojące, to prostota zastosowanych środków. Moore nie korzystał z zaawansowanych laboratoriów ani kosztownego sprzętu wojskowego. Inteligentne okulary kosztują kilkaset dolarów i są dostępne w detalicznej sprzedaży. Oprogramowanie do zamiany twarzy, takie jak DeepFaceLive czy Faceswap, jest darmowe. Generatory syntetycznych twarzy – jak witryna ThisPersonDoesNotExist – są dostępne dla każdego w przeglądarce internetowej. Wirtualna kamera OBS Studio z modułem Roop pozwala na manipulację sygnałem wideo w czasie rzeczywistym przy użyciu jednego zdjęcia.

„Rynek zbyt szybko zaadoptował technologię rozpoznawania twarzy. Ataki, które przeprowadziłem, nie wymagają drogiego sprzętu ani specjalistycznej wiedzy – wystarczy laptop i powszechnie dostępne oprogramowanie.” – Jake Moore, Global Cybersecurity Advisor, ESET.

Ekspert wskazał, że obecna architektura weryfikacji tożsamości jest strukturalnie złamana. Twarze i głosy są łatwe do sfałszowania, bo większość systemów opiera się na słabych mechanizmach liveness detection – weryfikacji, czy po drugiej stronie kamery stoi żywy człowiek, a nie jego cyfrowa kopia. Sygnały behawioralne i kryptograficzne są tymczasem niemal całkowicie pominięte.

Globalny kontekst: rynek wart miliardy, podatność liczona w procentach

Eksperyment Moore’a wpisuje się w szerszy obraz kryzysu zaufania do technologii biometrycznych. Według danych NIST (National Institute of Standards and Technology) z raportu FRVT 2025, dokładność najlepszych algorytmów rozpoznawania twarzy przekracza 99% dla czystych danych testowych – ale spada do poziomu 80-90% w warunkach ataków deepfake lub przy niskim oświetleniu. Innymi słowy: technologia jest niemal bezbłędna w warunkach laboratoryjnych i zawodna dokładnie wtedy, gdy ktoś aktywnie próbuje ją złamać.

Globalny rynek facial recognition wyceniany jest na 7 miliardów dolarów w 2026 roku (dane Statista) i obejmuje ponad 50 krajów. Jednak według raportu Deepfake Detection Challenge 2025, oprogramowanie do zamiany twarzy omija systemy biometryczne z skutecznością na poziomie 70-95%. Z kolei iProov – firma specjalizująca się w wykrywaniu syntetycznych tożsamości – wskazuje w raporcie z 2026 roku, że modele AI generują twarze nie do odróżnienia od prawdziwych w ponad 90% przypadków testowych.

Skala nadużyć jest już zauważalna w danych regulatorów. FCA (Financial Conduct Authority) w Wielkiej Brytanii odnotowała wzrost liczby oszustw bankowych z użyciem deepfake’ów o ponad 300% w stosunku do 2024 roku. W Polsce sytuację reguluje kombinacja RODO i wchodzącego w życie AI Act, który od 2026 roku wymaga implementacji mechanizmów liveness detection w systemach weryfikacji biometrycznej. Mimo to, według danych UOKiK, nawet 40% systemów bankowych stosowanych w Polsce nie ma wdrożonej tej ochrony.

Eksperci: To nie jest problem technologii, lecz zaufania

Rewelacje z eksperymentu Moore’a skonfrontowały branżę z pytaniem, które – jak wynika z dyskusji po RSAC 2026 – było zadawane od dawna, ale zbyt rzadko na głos: czy implicite zakładamy, że technologia rozpoznawania twarzy jest bezpieczna, bo tak mówi jej producent? Odpowiedź brzmi: tak, i to jest podstawowy błąd.

„Systemy facial recognition są wdrażane z domyślnym zaufaniem, które nie odpowiada ich rzeczywistej odporności na próby włamania – nawet przy użyciu sprzętu dostępnego w sklepach i oprogramowania freeware.” – Tomáš Foltýn, redaktor WeLiveSecurity, ESET.

Podobne obserwacje formułuje środowisko badaczy biometrii. Standardy takie jak ISO 30107, dotyczące detekcji ataków prezentacyjnych (zdjęcia, replay wideo), zakładają skuteczność na poziomie 20-40% – co oznacza, że nawet przy pełnej zgodności z normą, jedna na trzy próby ataku może zakończyć się sukcesem. Gdy do gry wchodzą deepfake’i, liczby stają się jeszcze bardziej niepokojące.

Eksperci ds. bezpieczeństwa zgodnie wskazują, że kluczowym rozwiązaniem jest podejście zero-trust biometrics – strategia, którą promuje m.in. ESET. Oznacza ona rezygnację z traktowania twarzy jako jedynego i wystarczającego sygnału tożsamości na rzecz wielowarstwowej weryfikacji. Uwierzytelnianie wieloskładnikowe (MFA) powinno być standardem, nie opcją. Polskie instytucje finansowe, takie jak mBank czy PKO BP, testują już rozwiązania hybrydowe łączące rozpoznawanie twarzy z behavioral biometrics – analizą wzorców zachowania, takich jak ruchy myszy czy sposób trzymania urządzenia mobilnego.

Konsekwencje dla firm i marketerów: ryzyko i szansa jednocześnie

Eksperyment Moore’a ma istotne implikacje nie tylko dla działów IT i compliance, ale również dla marketerów i strategów komunikacji. Rosnąca świadomość luk w biometrii przekłada się na konkretne trendy konsumenckie: zaufanie do cyfrowych usług weryfikacji tożsamości spada, a zapotrzebowanie na przejrzystą komunikację o metodach zabezpieczeń rośnie.

Kampanie edukacyjne dotyczące cyberbezpieczeństwa notują wzrost zaangażowania – hashtag #FaceTheft na platformach takich jak TikTok czy Instagram Reels generował w tygodniach po RSAC 2026 o 25% wyższy engagement niż typowe treści z kategorii tech. Jednocześnie algorytmy platform społecznościowych coraz agresywniej walczą z deepfake’ami: Meta blokuje szacunkowo 80% takich materiałów, podczas gdy TikTok – ok. 60%.

Dla firm oferujących rozwiązania z zakresu bezpieczeństwa lub obsługujących dane klientów w kanałach cyfrowych eksperyment stanowi zarówno ostrzeżenie, jak i punkt wyjścia do budowania przewagi komunikacyjnej. Transparentność w kwestii stosowanych metod ochrony tożsamości oraz proaktywne informowanie klientów o ryzykach i zabezpieczeniach stają się elementem zarządzania reputacją – nie tylko obowiązkiem regulacyjnym.

- Stosuj wieloskładnikowe uwierzytelnianie (MFA) jako standard, a nie opcjonalne uzupełnienie – szczególnie w aplikacjach lojalnościowych i e-commerce

- Weryfikuj dostawców systemów biometrycznych pod kątem implementacji liveness detection zgodnej z wymogami AI Act

- Regularnie testuj systemy weryfikacji tożsamości w warunkach symulowanych ataków – tzw. red teaming

- Buduj kampanie edukacyjne informujące klientów o zagrożeniach deepfake i sposobach ochrony ich danych biometrycznych

- Monitoruj wskaźniki: odsetek prób oszustw z użyciem syntetycznych tożsamości, skuteczność liveness check, czas reakcji systemu na anomalie

ESET

ESET to europejski lider cyberbezpieczeństwa z siedzibą w Bratysławie, założony w 1992 roku. Firma zatrudnia ponad 2000 specjalistów i chroni ponad 110 milionów użytkowników w 200 krajach. Jest twórcą popularnego antywirusa ESET NOD32 oraz rozbudowanego ekosystemu rozwiązań bezpieczeństwa dla firm i konsumentów. ESET znany jest z agresywnych badań nad zagrożeniami cyfrowymi – w tym m.in. z odkrycia złośliwego oprogramowania Industroyer, które atakowało ukraińską infrastrukturę energetyczną. Platforma WeLiveSecurity to jeden z najbardziej cenionych blogów cyberbezpieczeństwa na świecie, nagradzany przez branżowe organizacje z USA, Europy i Azji.